Исследователи разработали очередной механизм обмана систем распознавания лиц. Созданная ими генеративно-состязательную нейросеть научилась строить изображения, которые человек воспринимает как фото одного человека, а система распознавания лиц — как фото другого. Из этого следует призыв к вендорам — тщательнее тестировать свои продукты на устойчивость к вводу необычных и противоречивых данных.

Обманывать систему распознавания лиц, заставляя её ошибочно принимать одного человека за другого, смогли исследователи из компании McAfee. Подобная работа позволяет специалистам найти предел возможностей современных систем распознавания лиц и побудить разработчиков интенсивнее заниматься их улучшением. Недавно другая группа учёных сообщила о создании программного алгоритма, который меняет фотографию так, что система распознавания воспринимает её как лицо другого человека.

Главная задача исследователей из McAfee состояла в том, чтобы определить, можно ли на основе системы машинного обучения создать фейковое изображение, на котором человек узнавал бы одну персону, а система распознавания лиц — другую.

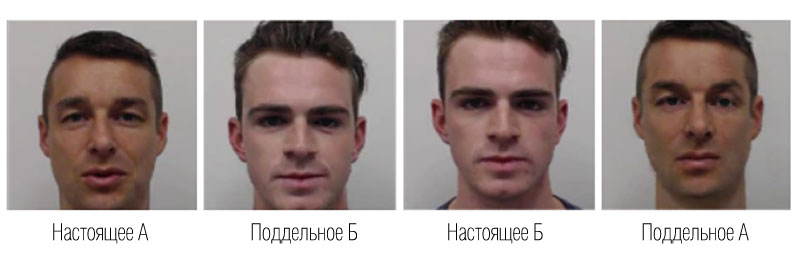

В проведённом исследовании использовалась генеративно-состязательная нейросеть — система машинного обучения, которая содеожит две противоборствующих нейросети. Такая сеть способна независимо создавать данные, очень похожие на данные, которые в неё вводятся, например транслировать изображения зебр в изображения лошадей. По набору реальных фото лиц людей генеративно-состязательная нейросеть может производить изображения лиц — искусственные, но выглядящие абсолютно реально. При этом сеть последовательно достигает требуемого качества.

В ходе работы в нейросеть вводили набор из 1500 фотографий двух человек. Сеть последовательно создавала и тестировала поддельные изображения, смешивая между собой черты лиц обоих субъектов. После сотни циклов подготовки сеть пришла к результату: она генерировала изображения, выглядевшие как легальные фото на паспорт одного из этих двух людей, в то время как система распознавания лиц идентифицировала их как фото второго человека.

Исследователи говорят, что по подобному сценарию вполне можно атаковать систему верификации паспортов, хотя это и потребует приложения определённых усилий. При этом атакующему вообще не нужно иметь доступа к паспортной системе.

«Аномальное тестирование, конфронтационный ввод данных и большее разнообразие вводимой информации помогли бы вендорам улучшить их системы распознавания лиц», — призывают исследователи.